はじめに

デジタル化された楽曲データを見ると、サンプリングレートや量子化ビット、ビットレートなどの様々な数値がでてきます。ま、PCの世界では基本的には数字が多い方が良いことが多いですが、一応その数字の意味についてちょっとお話ししたいと思います。

種類

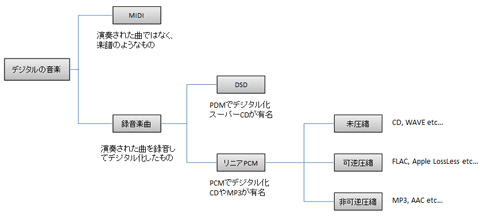

PCで扱う音楽のデータを大雑把にわけると図のようになります。

まず、大きく分けて2種類あります。

- 実際に演奏した曲ではなく楽譜のような曲のデータ

MIDIやファミコンのBGMがこれに当たります。

データ量が圧倒的に小さいのと高度な編曲が可能なのが特徴です。 - 実際に演奏された曲を録音してデジタル化したもの

CDなど音楽を聴くというと一般的にはこれが該当します。

さらに、2.のように録音された曲は音をデジタル化する方式によって2種類あります。

- PDM(パルス密度変調)方式

DSDと呼ばれ、スーパーCDなどに使われています。音質面で優れると言われています。

- PCM(パルス符号変調)方式

リニアPCMやWAVEと呼ばれ、CDやMP3などに使われています。デジタル化が簡単という特徴があります。

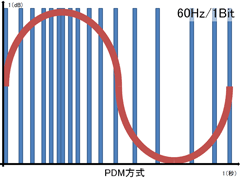

図では1Hzの波をデジタル化する方法をザクッと表現しています。

左がPDM方式で、簡単に言えば多い回数で分割して、0か1の1段階でデジタル化しています。1が多ければ波が高い状態、0が多ければ波が低い状態です。パルス(1ビットの信号)の密度で波を表しているのでパルス密度変調なワケです。

一見すると分りづらいですが、一定間隔で平均して面積を見るとアナログの波に近くなります。実はこれはアナログの波を作るときに(似た方式のPWMと共に)よく使われる手法で、D/Aコンバーターでも最終的にはPDMやPWMでアナログの音が出力されているということは知っていて損はないでしょう。

右がPCM方式で、簡単に言えば、波を何分割かして、複数の段階でデジタル化しています。図では6分割して4段階(2bit)でデジタル(符号)化しています。波をそのままデジタル化しているので直感的で分りやすいと思います。

ちなみに、2bitは[0.0][0.1][1.0][1.1]の4段階を表すことができ、2のN乗(Nがビット数)で計算することができます。16bitであれば2の16乗で65536段階です。CDは波を1秒間に44100分割して、それぞれの音を16bit(65536段階)で表しているということです。それぞれ、サンプリングレートと量子化ビットと呼びます。

方式としてはこのように分類されますが、実際にはほとんどの人が聴く曲はPCM方式によってデジタル化された音楽だと思います。この音楽データは圧縮するかどうか、また圧縮するならばその方式などによって分けられます。

圧縮方式について詳しくは『Column 08』を参照ください。

サンプリングレートと量子化ビット

前項でお話しした通り、私達の身の回りの楽曲はほとんどがPCM方式でデジタル化されたデータです。PCM方式でデジタル化する際のパラメータは『サンプリングレート』と『量子化ビット』の2つです。CDで言えばサンプリングレートは44.1kHzで、量子化ビットは16bitです。ちなみに、ビットレートは1秒間のデータ量を表すことばで全く別物です。

ビットレートについて詳しくは『Column 08』を参照ください。

サンプリングレート

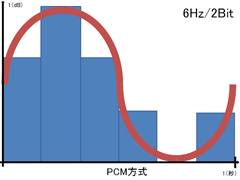

サンプリングレートをお話しする前に、サンプリング定理というのを紹介したいと思います。教科書などでは『ある波に含まれる最大周波数がfの時、その2倍の2fの周期で標本化すれば復元することができる』というような難しい話がでてくると思います。

細かいことは私も分らないので置いておくとして。。。、簡単に考えると、例えば1秒間に1周期の波(1Hz)を、1秒間に何分割かしてデジタル化するとします。すると1Hzの波を表現するには最低でも1秒間に2分割はしないと元に戻せません。下の図では2Hzでは波が復元できそうですが、1Hzだと波になりません。単純に行ってしまえばこんなイメージです。

この何分割かして数値をとることを標本化とかサンプリングと言います。途切れなく続くアナログの波を一定間隔で抜き取って値を記録していくので、標本・サンプルをとる=標本化・サンプリングと呼ばれるのです。

人間の耳は20Hz~20000Hzまでが可聴域と言われています。つまり40000Hz(40kHz)以上でサンプリングすれば、人間の聞こえる音が余すことなくデジタル化できるということになるわけです。でも、これだけだとCDの44.1kHzの理由が説明できません。40kHzとかせめて44kHzでも良さそうなものです。

実はデジタル音楽を録音するにあたって、最初の頃はすでにあるVTRのビデオレコーダーを使いました。ビデオは525(水平走査線)×30(フレーム数)で15.75kHzで記録されています。このうち、走査線がブラウン管の下から上に移動する垂直帰線期間にあたる水平走査線40本分には映像が記録されていません。

ビデオレコーダーの多くがそのタイミングを利用してVTRのヘッドの切替え(インターレースの上位フィールド用と下位フィールド用の2つのヘッドの切替え)などを行うのでノイズが発生しやすく、この部分(キリの良い35本分)を除外して、そこに3サンプルずつ記録するようにしました。これで、(525-35)×30×3で44.1kHzとなるわけです。

余談ですが、走査線の数が525本なのにDVDの画像の高さが480となっている理由は、この垂直帰線期間を除いたからです。それでも5本ほど少ないですが、アナログでは厳密にすべて表示できていたわけではないので、480本でもビデオ以上の解像度は得られるようです。

デジタルでは有名なサンプリングレートといえば他に48kHzがあります。これは衛星放送Bモードで採用されたものですが、DATやDVDでも採用されて今に至っています。DVDで採用されたことから動画の音声として定着して、現在でも馴染みのあるサンプリングレートとなっています。

ちなみに、48kHzは44.1kHzより若干周波数が高いので音質も多少良くなるのでしょうが、ほとんど誤差です。ではなぜ44.1kHzではなく48kHzにしたのかというと、どうやら大人の事情が絡んでいるらしく、CDと同じ44.1kHzにしてしまうとコピーが簡単にできてしまうので意図的に変えたのだそうです。当時は今のような強力なプロセッサもなく、サンプリングレートの変換も大変な手間がかかる作業だったという名残とも言えます。

さて、さきほどサラっと重大なことに触れました。実はサンプリング定理からサンプリングレートは40kHzで人間に聞こえる音はすべて再現でき、逆にこれ以上あげても人間に聞こえる音としては差はでないということが言えるのです。ハイレゾ音源の利点が根底から崩れ落ちる重大な事実です。

もっとも、これに関しては色々な分野で議論の対象となっていますが、拳法の達人の言葉を借りれば『聴くんじゃない、感じるんだ』的なノリなのかもしれません。

量子化ビット

量子化ビットは音の強弱を何段階で表すかを決める数値で、CDは16bit、ハイレゾ音源などでは24bitや32bitなどがあります。

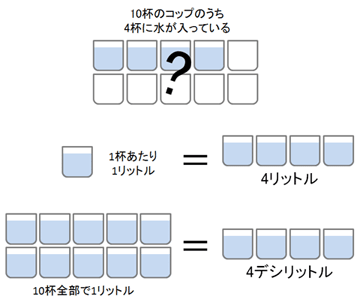

とはいえ、何も決めずに10段階のうち4段目などと言われてもどの程度のものなのか再現できません。再現するためには『1段階あたり大きさ』か『最大値(最大値と最小値の差)』のどちらかが必要です。

上の図ではコップの水を例にしましたが、コップ一杯あたりの量(1段階あたりの大きさ)か、コップ10杯全部の量(最大値)が分ればコップ4杯の量も決まります。

音のデジタル化は1段階あたりの大きさを決める方式を採用していて、『1bitあたり6dB』となっています。つまり16bitでは96dB、24bitでは144dBを再現できます。人間の耳で聴くことができるダイナミックレンジ(音の強弱)は130dBぐらいといわれており、音楽なんかでは96dB以上のダイナミックレンジのものも少なくありません。そういう意味ではサンプリングレートと違って24bit化は音質面で有効ということがわかります。

さらにレコーディングでは、音量レベルがオーバーしないように音量を少し低めに設定して後で音量を上げて調整したりしますが、そうすると引き延ばされて1段あたりが粗くなるため、最終的に作成する量子化ビット数よりも多い値で録音することが好ましいと言えます。レコーディング機器で早くから24bit化が果たされていたのはここに理由があります。

余談ですが、dBは一般的なリニア(線形)な数字ではなくログ(対数)で、6dBあがるごとに2倍になります(これが1ビットあたり6dBの理由)。ですから、60dBの音と66dBの音は数字では6dBしか違わず誤差のように見えますが、音の強さは2倍になります。なお、人間の耳はもうすこし緩やかで10dB違うと音がだいたい2倍になったと感じるそうです。